近日,美国专利商标局公布了苹果公司的一项专利申请,该专利涉及评估用户眼睛瞳孔特征的系统、方法和设备,该系统、方法和设备利用眼睛反射的光来估计用户的注视方向,使用多个闪光来识别用户的眼睛形状、位置和方向。在各种实施方案中,瞳孔特征评估被用来促进注视点追踪,这可用于实现用户交互。

上周,苹果分析师郭明錤表示,"苹果未来的头显将包括创新的人机UI技术,如手势控制、物体检测、眼睛/注视点追踪、虹膜识别、语音控制、皮肤检测、表情检测和空间检测。"

而在此前苹果公司已经发布了一些涵盖眼睛和注视点追踪的专利,很明显这项技术将在苹果公司未来的混合现实头显中发挥重要作用。

苹果公司在他们的专利文件中指出,现有的瞳孔检测技术可能使用一个图像传感器,并在一个曝光期整合光强度水平,以产生灰度图像,然后试图使用灰度图像检测瞳孔。瞳孔是基于瞳孔区域和周围虹膜区域之间的灰度对比度来检测的,因此依赖于瞳孔和虹膜之间的显着对比度。这样的瞳孔检测技术可能不那么准确或有效,特别是在瞳孔和虹膜之间的对比不那么明显的情况下,而这正是苹果公司的发明所要解决的问题。

苹果公司的发明涵盖了一种瞳孔特征评估系统,该系统包括一个光源、一个图像传感器和一个处理器,该处理器根据从光传感器收到的用户眼睛反射光线数据进行瞳孔特征评估。在不同的实施方案中,瞳孔特征是使用来自光源的轴上照明来确定的,这样一来,来自光源的光被反射到眼睛的视网膜上,能够在图像传感器获得的数据中产生一个明亮的瞳孔类型的光图案。

该光可被调制或以其他方式在某一频率下脉冲,频率分割可用于区分通过瞳孔从视网膜上反射的光和来自其他光源的反射。在一些实施方案中,图像传感器是一个基于帧的相机,该方法从下一个图像中沿图像序列减去一个图像,以识别图像中以频率出现的光脉冲。

在一些实施方案中,图像传感器是一个事件相机,对应于从视网膜反射出来并通过瞳孔的光的事件之间的时间量,用来确定以该频率发生的事件。

该事件相机在多个相应位置上有光传感器。响应于特定的光传感器检测到光强度的变化,光传感器会产生一个事件信息,指示特定光传感器的特定位置。

事件相机可以包括或被称为动态视觉传感器(DVS)、硅视网膜、基于事件的相机或无框架相机。因此,事件相机产生(和传输)关于光强度变化的数据,而不是关于每个光传感器的绝对强度的大量数据。

图源:patentlyapple

图源:patentlyapple

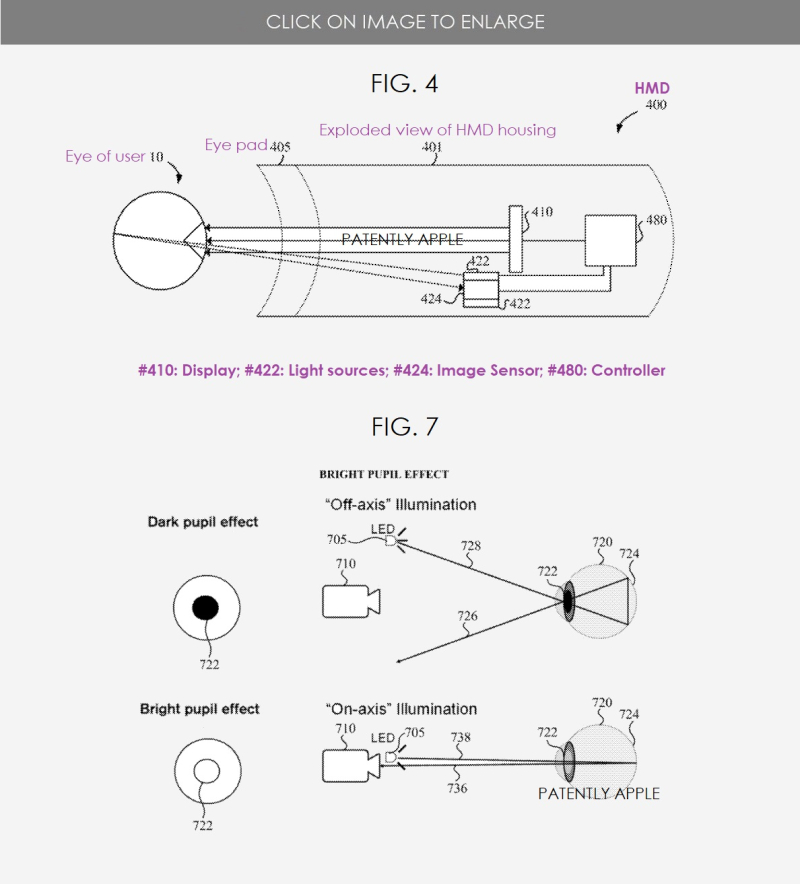

苹果公司的专利图4是一个头戴式设备(HMD)的分解方框图;图7是一个功能方框图,说明了亮瞳效应和暗瞳效应之间的差异。

更具体地说,图4的外壳#401还容纳了一个瞳孔评估系统,包括一个或多个光源#422,图像传感器#424,和一个控制器#480。一个或多个光源向用户的眼睛发射以及反射光线(例如,定向光束),可由传感器检测。基于这些反射,控制器可以确定用户的瞳孔特征。

作为另一个例子,控制器可以确定瞳孔中心、瞳孔大小、注视方向或注视点。因此,在各种实施方案中,光由一个或多个光源发出,从用户的眼睛上反射,并由传感器检测。在不同的实施方案中,来自用户眼睛的光线在到达传感器之前会被热镜反射或通过目镜。

图源:patentlyapple

图源:patentlyapple

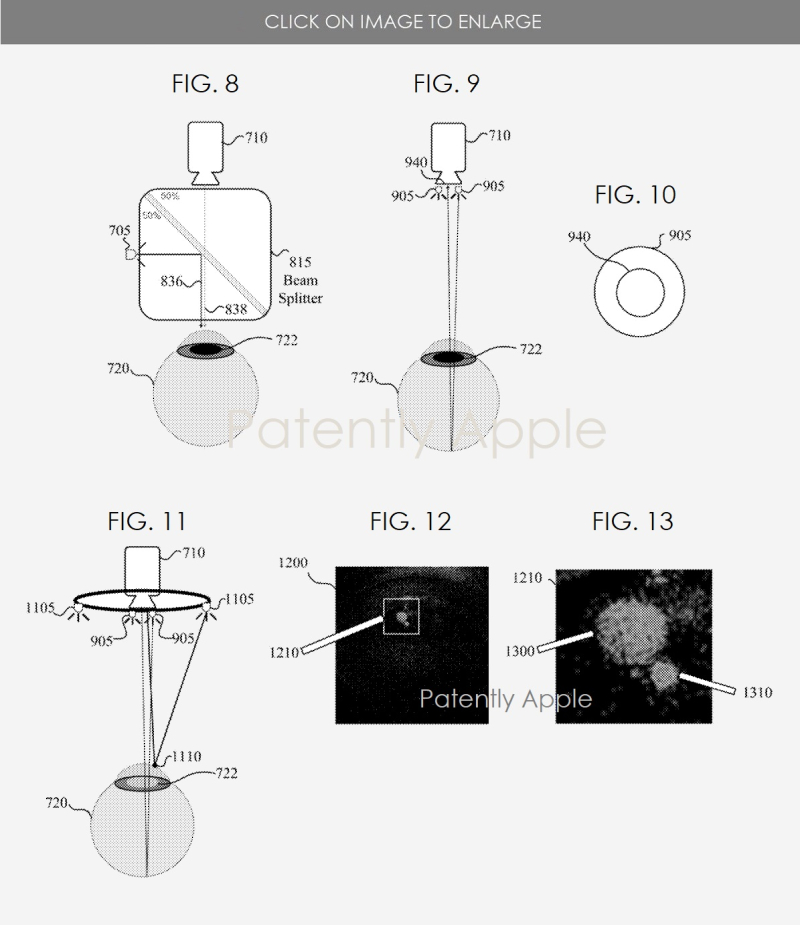

苹果公司的专利图8是一个功能框图,说明使用分光器来提供大约在轴上的照明;图9是一个功能框图,说明在光传感器的光学元件附近使用光源环来提供大约在轴上的照明;以及图10是一个功能框图,说明图9的光源环。

苹果公司的专利图11说明了一个功能框图,说明将基于轴上照明的瞳孔检测与基于离轴照明的眼睛特征检测相结合;图12说明了在轴上照明期间获得的事件相机数据的收集;图13说明了图12的事件相机数据的一部分近景。

想了解更多细节,可查阅苹果公司的专利申请20210378509。考虑到这是一项专利申请,目前还不知道包含专利技术的产品何时会上市。

该专利将Walter Nistico列为唯一发明人。Nistico是苹果公司的深度学习和计算机视觉工程经理。4年半前,Nistico随着苹果公司收购SMI SensoMotoric Instruments GmbH而加入了苹果。在加入苹果公司之前,Nistico还曾与谷歌、高通、索尼、Nvidia和英特尔合作开展VR和AR项目。

评论