学界和业界对虚拟现实显示器的探索主要集中在达到普通显示器的同等水平,包括提高分辨率、减少延迟、缓解视觉辐辏调节冲突、以及实现更为舒适的形状参数。但所述媒介的一个核心缺陷是:用户与周遭的人与物形成了隔绝。

解决所述问题是Meta等厂商积极开发视频透视的关键动机。但尽管有了透视功能,非VR人员依然无法与VR头显用户进行自然的对话,因为上脸和眼睛的遮挡问题尚未得到解决。

为了描绘遮挡脸部的特征,Meta已经进行了大量的探索,包括映维网早前分享的博文《Facebook展示反向透视VR头显,允许看到头显用户的眼部表情》。其中,由研究科学松田内森(Nathan Matsuda)领衔的团队介绍了一种反向透视VR头显,从而允许外部人员看到头显用户的眼部表情。

在日前公布的一份论文《VR social copresence with light field displays》中,同一团队进一步详细介绍了这一概念的动机、实现和评估。

1. 动机与局限

与透视VR为头显用户提供逼真的立体图像类似,团队提出了一种反向透视VR头显:在头显前端提供一个能够实时重建被遮挡面部区域的显示屏。

尽管基础技术已经开发了几十年,但团队没有发现有人尝试以这种方式将其结合起来。所以,Meta提出的系统利用了VR面部捕捉方面的最新研究和行业趋势,高分辨率自动立体显示器,以及更紧凑的VR头显等方面的进步,从而实现一种VR社交临场感。

这种具备立体感的反向透视VR能够比平板显示器更准确地描述用户的注视点和眼周区域,所以外部人员能够感知准确的运动视差和双目深度线索。

他们相信,如果开发成功,反向透视VR可以提高虚拟现实的社会接受度和自然交流感,因为诸如如睫毛、毛孔和绒毛等精细的面部特征都有助于感知人类情绪。

但团队指出,这一研究目前依然存在局限。当前的实现未能完整呈现遮挡的区域,整体相当怪异,不自然。另外,生成的人脸和眼睛图像分辨率不高,从而对感知造成了影响。

除了空间分辨率降低带来的限制外,团队选择的面部捕捉技术同样对反向透视VR原型形成了障碍。例如,研究人员实现了一个基于机器学习的立体重建框架,但它显示出深度重建错误,需要对红外摄像头捕获的图像进行着色。同时,系统不支持通过环境源对面部进行重新照明(这对于估计注视方向非常重要)。

综上所述,团队接下来的研发方向将包括采用增强的虚拟现实面部捕捉技术。

2. 实现

先前关于社交临场感方面的研究建立了自动立体显示器的需求,目标是从每位外部人员的有利位置准确再现设备用户的眼睛注视和面部外观。由于不正确的双目和运动视差深度提示,重新投影到2D显示器并不足够。所以团队制定了一个设计要求:反向透视VR系统必须使用自动立体显示器,否则外部人员将需要戴上特殊的眼镜,而这将进一步阻碍VR头显的实用性和社会接受性。

Meta认为基于微透镜阵列的光场显示器最符合当前研究和行业趋势。

基于偏振的光学折叠或Pancake光学的最新进展为显著减少头显体积开辟了道路。但是,维护这样细薄的外壳,同时添加反向透视VR显示器意味着大尺寸自动立体显示器,所以难以提供令人信服的设计选择。另外,面向世界端的显示器应足够明亮,以便在不同的照明条件下可见,同时消耗足够低的功率。

业界和学界进一步表明,全息光学可以进一步降低头显的厚度,并接近太阳镜的形状参数。所以,团队指出不排除将来使用全息显示器的可能性,因为考虑到当前最先进的显示面板分辨率、新兴的VR光学元件、以及支持图像平面所需的有限景深,光场显示器非常适合今天构建反向透视VR系统。

光场显示器将四个空间角度尺寸复用为平板显示器支持的两个维度。有效空间分辨率和虚拟图像距离之间的关系由显示像素间距、微透镜阵列(MLA)间距和MLA焦距决定。团队注意到,MLA间距、焦距、视场和基本图像大小相互关联,并且取决于微透镜材料的折射率。

对于团队提出的反向透视VR头显,物理原型设计所使用的组件足够合理,并且在大多数情况下已经可以现货供应。他们按照这一原则设计了硬件子系统(光场显示和立体摄像头系统)和软件子系统(眼睛图像合成、摄像头和显示器校准以及光场渲染)。

考虑到VR头显越来越薄的趋势,研究人员围绕Pancak透镜的典型总轨迹长度设计了一个反向透视模块。每个模块都包含一个VR显示器和一个Pancake光学元件、一个外部光场显示器和一个眼动捕捉子系统(见图3)。

整机包含两个这样的模块,每只眼睛一个,通过碳纤维棒牢固地安装在鼻梁,并通过Oculus Go的头带固定到头部。

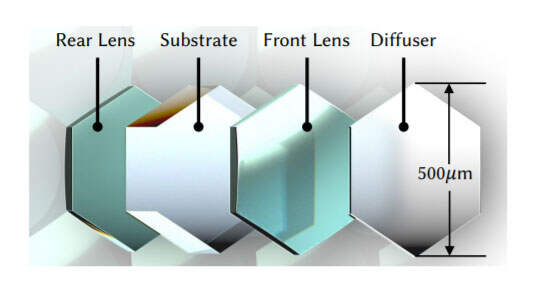

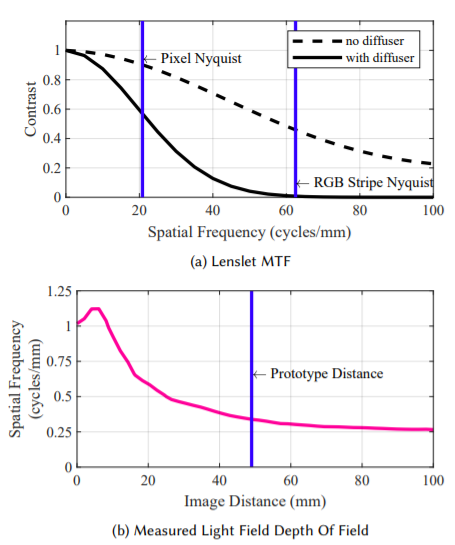

如前所述,基于MLA的光场显示非常适合这一应用。团队通过使用现有LCD和商业成熟的树脂成型制造技术来实现高性能MLA设计。然后,其展示了使用传统的游戏渲染引擎可以实时驱动所述显示器。为了在给定焦距下最大化视场,MLA透镜需要尽可能快速(高数值孔径),同时保持成像性能。双面MLA将光功率分布在两个表面,与单面MLA相比减少了像差。为了简化制造和降低成本,两个表面采用相同的光学配方设计。由此产生的透镜设计使用六角压缩透镜阵列,每个透镜阵列支持一个42度视场,有效焦距520𝜇m,如图4所示。

团队选择将扩散器作为一个单独的层安装在MLA堆栈中。如上图所示,除了散焦亚像素外,扩散器同时可以消除由亚像素间距和MLA间距引起的莫尔效应。微透镜阵列采用京东方的1600×1600彩色LCD,其具有24个𝜇m像素间距(8𝜇m RGB条纹)。研究人员使用基于Synaptics VXR7200的显示桥驱动所述显示器。

接下来,团队继续尽可能地使用现有技术,并设计了一个与现有眼动追踪架构兼容的眼睛捕获系统。然后,他们对显示器进行了校准。

如前所述,LCD和MLA的制造精度大大减少了实际中每个显示器需要校准的参数数量。在校准显示器时,团队使用实时渲染器扫描水平和垂直偏移,直到显示的十字线在显示中处于水平和中心位置。研究人员同时显示器进行了基本的颜色校准,方法是逐步通过灰度0-255。

3. 实验评估

团队注意到,光场显示器需要牺牲分辨率以产生自动立体图像。与2D显示器相比,增加的深度精度是否优于丢失的分辨率?在房间里存在多人的大多数情况下,使用2D显示器不起作用,但在单个观众的情况下,光场替代方案应提供同样好或更好的社交提示。在单用户情况下,2D显示器失败的一个关键原因是缺乏立体感。对于一只眼睛或眼睛的平均位置,重投影视图可以为正确,但不能同时针对两只眼睛。

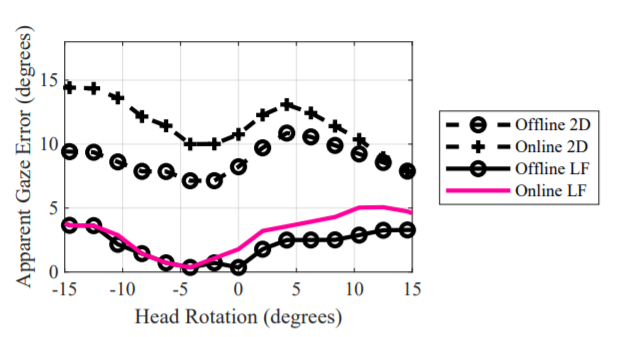

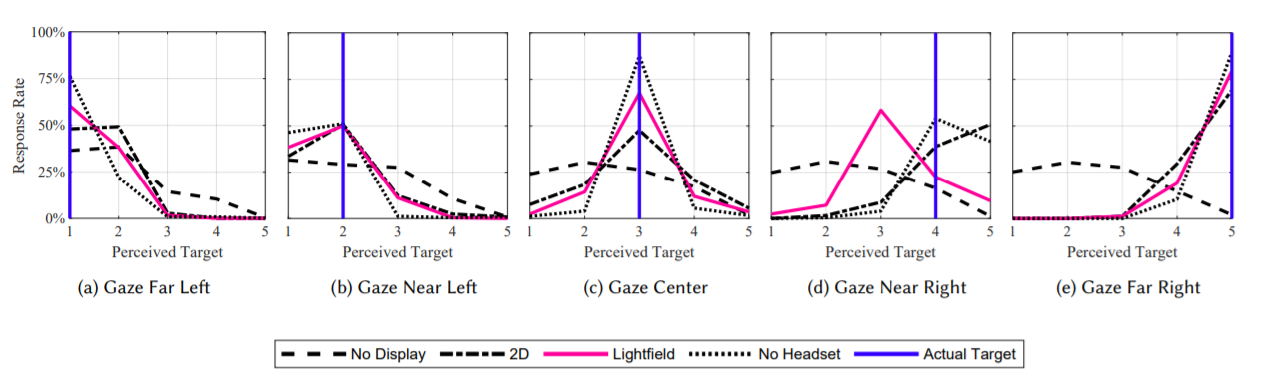

团队在实验中确认,尽管光场显示导致分辨率降低,但其提出的架构产生的瞳孔位移量小于等效2D投影方法的自立体眼部图像。简单来说,其能够更精确地传达注视点。

在初步的远程用户研究中,研究人员进一步评估了感知注视点的准确性。如上图所示,对于光场显示器,被试能够更频繁地准确地检测到VR头显用户的注视方向,相对2D显示器更接近于无头显状态。

4. 结论

在协作环境中采用虚拟现实将要求未来的头显支持用户和外部人员进行不对称交互。今天的头显已经可以通过视频透视技术允许用户感知周围环境中的其他人。在这个研究中,团队设计并构建了第一个使用自动立体显示系统,以实现相对自然和逼真的多人社交共在感。

当然,团队承认所述研究依然存在一定的限制,包括建模注视错误,优化面部重建和提升光场分辨率和视场等等。接下来,研究人员计划在未来的研究中继续探索优化。

文章来源:映维网

评论