近日,美国专利商标局正式授予苹果公司一项专利,该专利涉及具有显示生成组件和一个或多个输入设备的计算机系统,并提供计算机生成的体验,包括但不限于通过显示器提供虚拟现实和混合现实体验的电子装置。在很大程度上,苹果的发明深入了未来的混合现实头显,该头显将与微手势和眼动追踪相结合,在玩电子游戏、导航菜单和控制媒体播放时可能很有用。

在显示一个三维环境的同时,计算机系统会在第一位置检测到一只手,该位置与三维环境的一部分相对应。响应于检测到处于第一位置的手,根据确定该手正以第一预定义配置被握住,计算机系统显示用于在三维环境中使用手势输入的第一操作环境的视觉指示;以及根据确定该手未以第一预定义配置被握住,计算机系统则放弃显示该视觉指示。

在一些实施方案中,计算机系统允许用户使用手指相对于其他手指或同一只手的部分的小动作所执行的微手势来与三维环境(例如,虚拟或混合现实环境)互动。

微手势是用摄像头(例如,与头戴式设备集成的摄像头或安装在远离用户的地方,如在CGR房间)来检测的。例如,与触摸感应表面或其他物理控制器相反的位置。

微手势的不同运动和位置以及各种运动参数被用来确定在三维环境中执行的操作。通过使用摄像头捕捉微表情与三维环境进行互动,使用户可以在物理环境中自由移动而不受物理输入设备的束缚,这使用户可以更自然和有效地探索三维环境。

此外,微手势是离散且不显眼的,适合于可能发生在公共场合和/或需要礼节的互动。

手的准备状态配置被计算机系统用作指示,表明用户打算在与当前显示的操作环境不同的预定义操作环境中与计算机系统互动。例如,预定义的操作环境是在当前显示的应用程序之外与设备进行的一次或多次交互(例如,游戏、通信会话、媒体播放会话、导航等)。

图源:patentlyapple

图源:patentlyapple

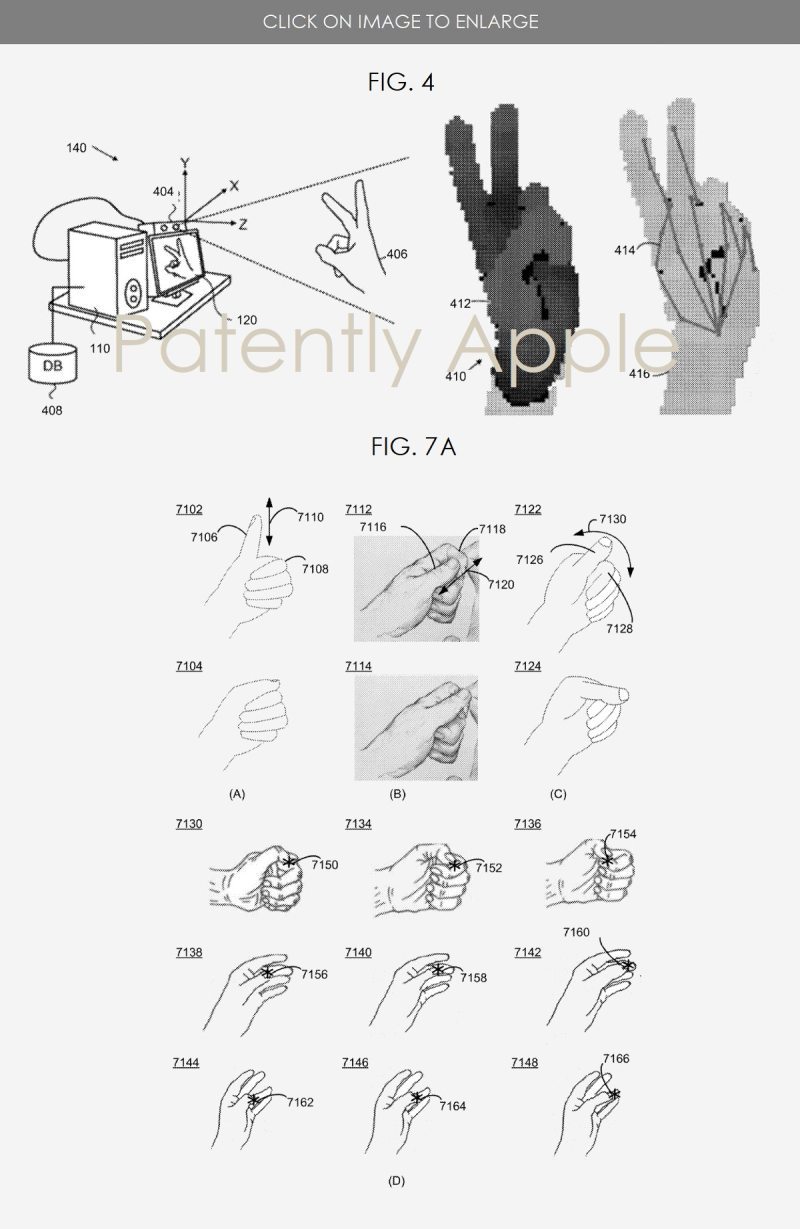

苹果公司的专利图4说明了手部追踪单元#243。在一些实施例中,眼动追踪单元被配置为追踪用户的注视点相对于用户手的位置和运动。专利图4进一步包括由图像传感器#404捕获的深度图#410的示意图。

专利图4还示意性地说明了控制器最终从手的深度图#40中提取的手的骨架#414。在图4中,该骨架被叠加在手部背景#416上,该背景已从原始深度图中分割出来。

在一些实施方案中,手的关键特征点(例如,对应于指关节、指尖、手掌中心、连接到手腕的手的末端等)以及可选地连接到手的手腕或手臂上的特征点被识别并位于手的骨架#414上。

在一些实施例中,这些关键特征点在多个图像帧上的位置和运动被控制器#110用来确定手部执行的手势或手部的当前状态。

图源:patentlyapple

图源:patentlyapple

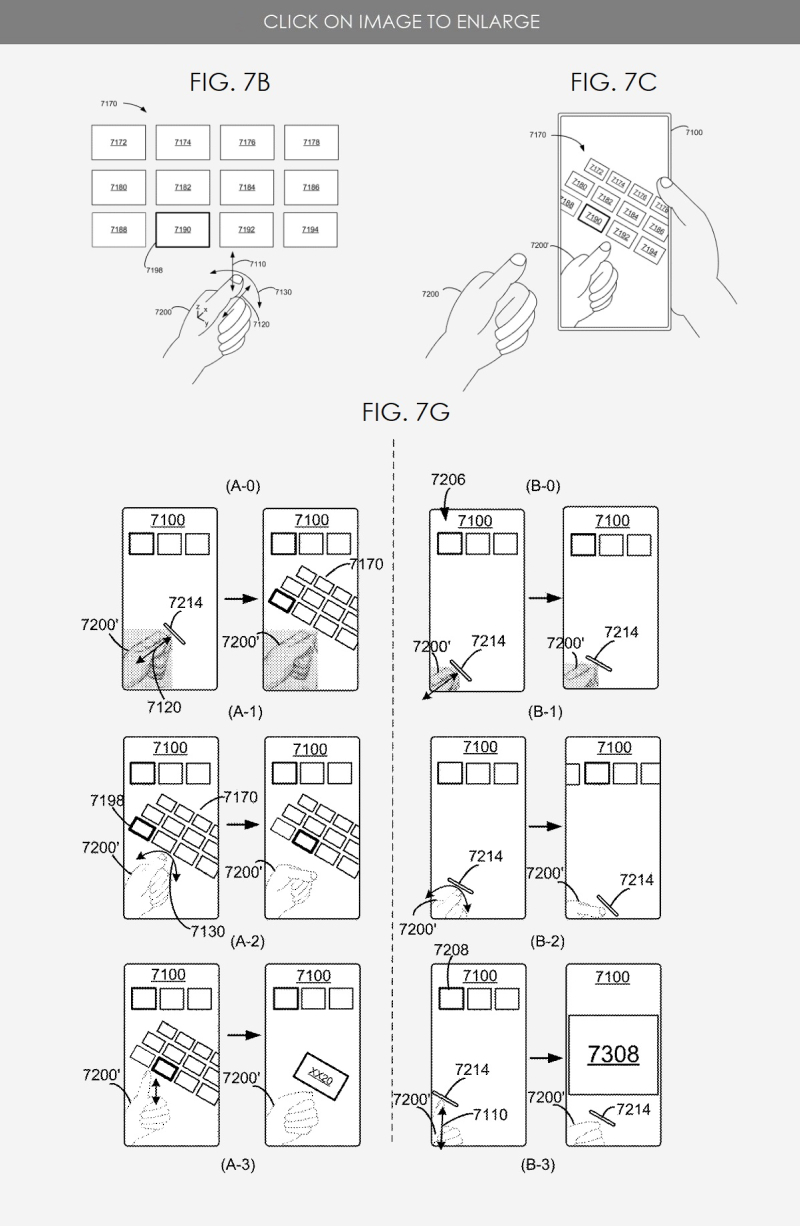

苹果公司的专利图7A提出了说明用户与三维环境交互的方框图。

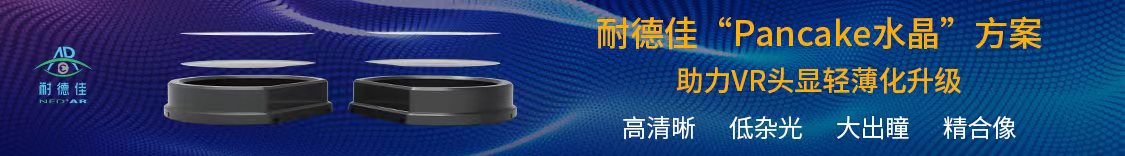

苹果公司的专利图7B说明了一个显示菜单#7170的用户界面环境示例,其中包括用户界面对象#7172-7194。该菜单在混合现实环境中显示。例如,漂浮在空中或叠加在三维环境中的物理对象上,并对应于与混合现实环境相关的操作或与物理对象相关的操作;图7C菜单#7170由设备(例如,设备#7100或HMD)的显示器显示,其中至少有一部分由设备#7100的一个或多个后向摄像头捕获的物理环境的视图叠加。在一些实施方案中,菜单显示在设备(例如,平视显示器或HMD)的透明或半透明的显示器上,通过该显示器可以看到物理环境。

苹果公司的专利图7G说明了用处于准备状态的手进行的示例手势和显示的三维环境的示例响应,该响应取决于用户的注视点。

在一些实施例中,用户的注视点指向三维环境中对手势输入有反应的虚拟物体,只有在发现用户的手也处于提供手势输入的预定义准备状态时,才会显示该虚拟物体可用的一个或多个互动选项的视觉指示。

来源:VR陀螺

投稿:tougao@arinchina.com

稿件/商务合作: Vicky(微信 ARC-vicky)

创始人:张明军(微信 13720775110)

更多精彩内容,请关注ARinChina微信公众号(ID:X增强现实)

评论