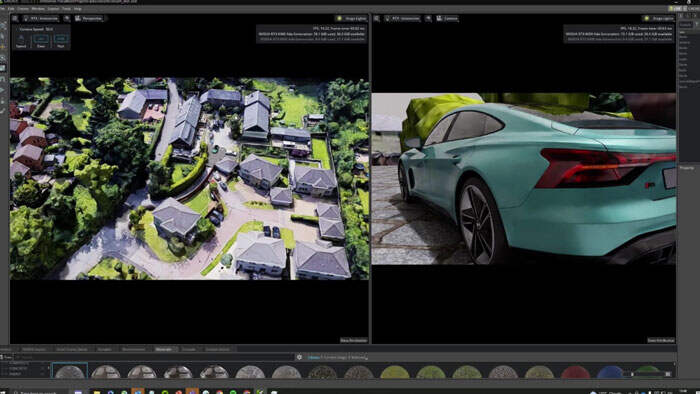

英伟达的NVIDIA Omniverse是一个沉浸式协作中心,它能够互联现有的3D工作流程,将线性流程升级为实时同步创作,支持你以前所未有的方式和速度进行沉浸式创作。

日前,英伟达日前宣布了Omniverse平台重大更新,包括对通用场景描述(OpenUSD)格式和OpenXR的支持、基于RTX的光追、全新的空间框架、生成式人工智能功能和空间计算增强等等。

使用OpenUSD实现沉浸式工作流程

OpenUSD是一项高性能3D场景描述技术,可为各种工具、数据和工作流带来强大的互操作性。OpenUSD以支持协作呈现艺术表达和提升电影内容制作效率的功能闻名业内。强大的功能和灵活性令其成为了承载新行业和应用需求的理想内容平台。

英伟达早前与苹果、皮克斯和Linux基金会等宣布共建3D格式OpenUSD联盟,并致力于推行OpenUSD的标准化、开发、迭代和发展。

现在,英伟达正在为Omniverse带来一个全新的空间框架来,通过OpenUSD来提高开发和部署速度。

在支持OpenUSD之后,用户现在可以直接在Omniverse创建与其他基于OpenUSD的空间计算平台兼容的内容、体验和应用程序,而空间计算选项可以本地集成到所有基于Omniverse的OpenUSD应用程序之中。

通过这种方式,可以大大减少摩擦并提高迭代速度。用户甚至可以将XR集成到现有的管道中,实现它不再需要耗费大量时间。

所述全新空间框架的主要特征包括:

- 添加沉浸式体验和基本XR功能的新工具。这简化了设计审查和工厂规划的工作流程。

- 将RTX光追功能和Omniverse接到SteamVR, OpenXR和NVIDIA CloudXR。

- 支持空间计算平台和耳机。Omniverse用户可以构建与其他基于OpenUSD的空间计算平台,例如如AR Kit和RealityKit)。另外,对Khronos Group OpenXR开放标准的新支持可以将Omniverse开发者的体验扩展到HTC Vive,,Magic Leap和Varjo等厂商的更多头显。

值得一提的是,新版本将通过与Omniverse的新集成和连接来扩展OpenUSD生态系统。例如,Adobe Firefly生成式AI模型将很快在Omniverse中作为API提供,从而改进设计工作流程。本次更新同时增加了与Luma AI,Convai,Inworld AI和其他平台的外连。

将XR集成到现有的3D工作流中

Omniverse应用程序开发者现在可以轻松地将XR集成到3D工作流程中。Omniverse中的全新空间框架可实现3D场景的实时沉浸式可视化。你同时可以将诸如传送、操作和导航等XR功能合并到现有的管道中。

利用所述空间框架,你可以在混合现实或完全沉浸式地跨设备查看工作资产。NVIDIA CloudXR提供完全不受限制的体验,并提供具有只有桌面计算才能实现的相同保真度。

另外,用户可以使用特定的扩展,而无需下载整个应用程序,从而实现更简单、更模块化的工作流程。同时,自动用户界面优化提高了应用程序的速度和生产力。

不仅只是这样,你可以部署定制的XR应用程序,并为特定的工作流设计用户界面,例如协作式产品设计审查和工厂规划。

开始使用Omniverse构建沉浸式体验和应用程序

现在,用户可以使用Omniverse Kit 105创建沉浸式体验。英伟达指出,USD Composer提供了一个测试Omniverse沉浸式体验的好方式。作为说明,USD Composer是Omniverse中的一个参考应用程序,允许你在其中轻松打开和制作USD stage。

要开始,从Omniverse启动器安装USD Composer。在窗口->渲染菜单中,找到VR和平板AR。如果你正在与另一个用户一起工作,则你可以利用USD Composer多用户工作流来实时沉浸式协作。

来源:映维网

投稿:tougao@arinchina.com

稿件/商务合作: 向前(微信 Shixiangqian7)电话:18700987744

创始人:张明军(微信 13720775110)

更多精彩内容,请关注ARinChina微信公众号(ID:X增强现实)

评论